Microsoft, OpenAI ile ortaklaşa olarak, ürün ve hizmetlerinde yapay zeka yeteneklerini istikrarlı bir şekilde kullanıyor. Görünüşe göre yazılım devi daha küçük senaryolar için de bir model oluşturuyor. Microsoft Research, büyük dil modellerini taklit ederek öğrenen Orca adlı yeni bir yapay zeka modelini tanıttı. Araştırma raporuna göre Orca, GPT-4 gibi büyük temel modellerinin akıl yürütme süreçlerini taklit ederek daha küçük modellerin sınırlamalarının üstesinden gelmek için tasarlandı.

Microsoft, OpenAI ile ortaklaşa olarak, ürün ve hizmetlerinde yapay zeka yeteneklerini istikrarlı bir şekilde kullanıyor. Görünüşe göre yazılım devi daha küçük senaryolar için de bir model oluşturuyor. Microsoft Research, büyük dil modellerini taklit ederek öğrenen Orca adlı yeni bir yapay zeka modelini tanıttı. Araştırma raporuna göre Orca, GPT-4 gibi büyük temel modellerinin akıl yürütme süreçlerini taklit ederek daha küçük modellerin sınırlamalarının üstesinden gelmek için tasarlandı. Microsoft Orca tamamen büyüleyici

Orca gibi dil modelleri belirli görevler için optimize edilebiliyor ve GPT-4 gibi büyük dil modelleri kullanılarak eğitilebiliyor. Daha küçük boyutu nedeniyle Orca, çalıştırmak ve işletmek için daha az bilgi işlem kaynağı gerektiriyor. Araştırmacılar modellerini kendi gereksinimlerine göre optimize edebilir ve büyük bir veri merkezine bağlı kalmadan bağımsız olarak çalıştırabilirler.

Orca gibi dil modelleri belirli görevler için optimize edilebiliyor ve GPT-4 gibi büyük dil modelleri kullanılarak eğitilebiliyor. Daha küçük boyutu nedeniyle Orca, çalıştırmak ve işletmek için daha az bilgi işlem kaynağı gerektiriyor. Araştırmacılar modellerini kendi gereksinimlerine göre optimize edebilir ve büyük bir veri merkezine bağlı kalmadan bağımsız olarak çalıştırabilirler. Araştırma makalesine göre, 13 milyar parametreyle çalışan bir yapay zeka modeli olan Orca, GPT-4 gibi büyük dil modellerini taklit edip onlardan öğrenebiliyor. Orca, bir trilyondan fazla parametreye sahip olduğu söylenen GPT-4’ün yardımıyla açıklamaları, adım adım düşünce süreçlerini ve diğer karmaşık talimatları öğrenebiliyor.

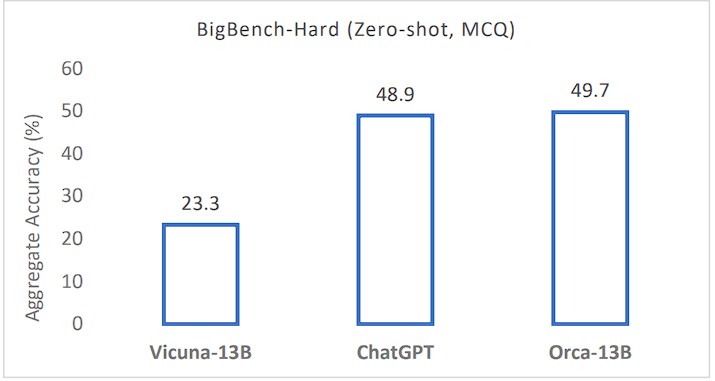

Küçük dil mdoelleri gibi modeller sözel tarzı taklit etmede başarılı olsalar da, olgusal doğruluk ve karmaşık düşünme konusunda sıklıkla yetersiz kalıyorlardı. Ancak Orca, daha büyük modellerin akıl yürütme sürecini taklit etmeyi öğrenen 13 milyar parametreli bir model geliştirerek bu açığı kapatıyor. Orca, çok sayıda kıyaslama ve testte diğer açık kaynaklı modelleri büyük bir farkla geride bıraktı ve düşünme yeteneği testinde GPT 4 ile eşleşti.

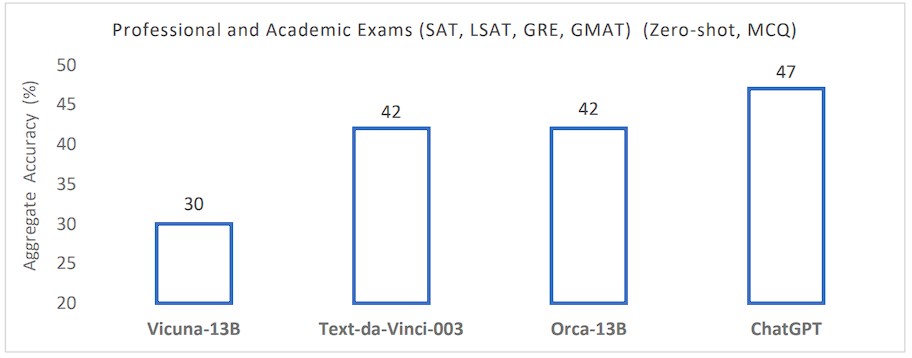

Küçük dil mdoelleri gibi modeller sözel tarzı taklit etmede başarılı olsalar da, olgusal doğruluk ve karmaşık düşünme konusunda sıklıkla yetersiz kalıyorlardı. Ancak Orca, daha büyük modellerin akıl yürütme sürecini taklit etmeyi öğrenen 13 milyar parametreli bir model geliştirerek bu açığı kapatıyor. Orca, çok sayıda kıyaslama ve testte diğer açık kaynaklı modelleri büyük bir farkla geride bıraktı ve düşünme yeteneği testinde GPT 4 ile eşleşti. Orca, daha küçük bir model olmasına rağmen Big-Bench Hard (BBH) gibi karmaşık muhakeme ölçütlerinde ChatGPT ile aynı seviyede bulunuyor. Ayrıca, GPT-4’ün gerisinde kalmasına rağmen SAT, LSAT, GRE ve GMAT gibi akademik sınavlarda rekabetçi bir performans sergiliyor. Orca gibi yapay zeka modelleri daha az boyutla daha büyük işler yaptıkça bu tip araçlar daha özel kullanımlara doğru kayacaktır. Esasında Orca, kullandığımız telefonlarda yerel olarak çalışan yapay zekalar için atılmış önemli bir adım.

Bir yanıt bırakın